জিজ্ঞেস করা হলে অধিকাংশ ব্যবহারকারী বলবেন, তাঁরা এআইকে (কৃত্রিম বুদ্ধিমত্তা) বিশ্বাস করেন না। আবার তথ্য দেওয়ার সময় এআই ৬০ শতাংশ ক্ষেত্রেই ভুল কিংবা কাল্পনিক তথ্য দেয়। তারপরও সাম্প্রতিক গবেষণার তথ্য বলছে, ইন্টারনেটে কোনো পণ্যের রিভিউ বা মন্তব্য পড়ার ক্ষেত্রে মানুষের লেখা সারাংশের তুলনায় এআইয়ের তৈরি করা সারাংশকে বেশি বিশ্বাস করছেন ক্রেতারা। শুধু তা-ই নয়, এসব সারাংশ পড়ে তাঁরা পণ্য কিনতে প্রলুব্ধও হচ্ছেন।

বিজ্ঞান বিষয়ক কনটেন্ট প্রকাশকারী ওয়েবসাইট লাইভ সায়েন্স আজ শনিবার এক প্রতিবেদনে জানিয়েছে, যুক্তরাষ্ট্রের সান ডিয়েগোয় অবস্থিত ইউনিভার্সিটি অব ক্যালিফোর্নিয়ার একদল গবেষকের গবেষণায় এ তথ্য উঠে এসেছে। তাঁরা দাবি করেছেন, এআই কীভাবে মানুষের আচরণে প্রভাব ফেলছে, তা নিয়ে এটিই প্রথম কোনো পরিমাণগত গবেষণা।

২০২৫ সালের ডিসেম্বরে ন্যাচারাল ল্যাঙ্গুয়েজ প্রসেসিং (এনএলপি) বিষয়ক একটি আন্তর্জাতিক এআই কনফারেন্সে উপস্থাপিত এই গবেষণায় কয়েকটি ধাপ ছিল। গবেষণায় ছয়টি এলএলএম (লার্জ ল্যাঙ্গুয়েজ মডেল), ১ হাজারটি ইলেকট্রনিক পণ্যের রিভিউ, সংবাদমাধ্যমে প্রকাশিত ১ হাজারটি সাক্ষাৎকার এবং সাড়ে ৮ হাজার প্রতিবেদন সমৃদ্ধ একটি সংবাদ ডেটাবেইস ব্যবহার করা হয়েছে।

গবেষকেরা এসব তথ্য দিয়ে এআইকে বিভিন্ন পণ্যের রিভিউ এবং সংবাদমাধ্যমে প্রকাশিত সাক্ষাৎকারের সারাংশ তৈরি করতে বলেন। এরপর সেগুলোকে সত্যতা যাচাই (ফ্যাক্ট চেক) করতে বলা হয়। দেখা গেছে, এআই বাস্তব খবর এবং কাল্পনিক খবরের মধ্যে পার্থক্য করতে হিমশিম খাচ্ছে।

গবেষকেরা তাঁদের প্রতিবেদনে লিখেছেন, ‘বাস্তব ও মিথ্যা খবরের পার্থক্য বুঝতে না পারা এআইয়ের একটি বড় সীমাবদ্ধতা। এটি সত্য-মিথ্যা আলাদা করতে পারে না।’

ক্রেতাদের বিভ্রান্তিকর সিদ্ধান্ত

গবেষণার সবচেয়ে চমকপ্রদ দিকটি ছিল অনলাইন কেনাকাটার রিভিউ নিয়ে। দেখা গেছে, একজন মানুষের লেখা দীর্ঘ রিভিউ পড়ার চেয়ে এআইয়ের তৈরি করা সংক্ষিপ্ত সারাংশ পড়ার পর মানুষ পণ্যটি কিনতে অনেক বেশি আগ্রহী হয়ে ওঠে।

গবেষকেরা এর পেছনে দুটি প্রধান কারণ খুঁজে পেয়েছেন- শুরুর তথ্যে গুরুত্ব এবং অসম্পূর্ণ ডেটা। এআই মডেলগুলো সারাংশের শুরুর দিকের তথ্যের ওপর বেশি জোর দেয় এবং মাঝের অংশকে কম গুরুত্ব দেয়। এই বিষয়টি মানুষের চিন্তাধারায় শুরুতেই প্রভাব ফেলে। তবে এআইয়ের ট্রেনিংয়ে নেই এমন কোনো নতুন তথ্য নিয়ে কাজ করার সময় এটি ভুল তথ্য বা মিথ্যা উত্তর দেওয়ার প্রবণতা দেখায়।

পরীক্ষায় দেখা গেছে, এআই চ্যাটবটগুলো প্রায় ২৬ দশমিক ৫ শতাংশ ক্ষেত্রে ব্যবহারকারীর আসল রিভিউয়ের মূল ভাব বা অনুভূতি বদলে দিয়েছে। আর যখন পণ্য সম্পর্কে সরাসরি প্রশ্ন করা হয়েছে, তখন তারা ৬০ শতাংশ ক্ষেত্রেই ভুল কিংবা কাল্পনিক উত্তর দিয়েছে।

গবেষণায় দেখা গেছে, যারা মানুষের লেখা রিভিউ পড়েছেন, তাদের মধ্যে ৫২ শতাংশ ক্রেতা পণ্যটি কিনতে চেয়েছেন। আর যারা এআইয়ের তৈরি সারাংশ পড়েছেন, তাদের মধ্যে ৮৪ শতাংশ পণ্যটি কেনার সিদ্ধান্ত নিয়েছেন। অর্থাৎ, এআইয়ের দেওয়া তথ্য ভুল হওয়া সত্ত্বেও তা মানুষকে কেনাকাটা করতে বেশি প্রলুব্ধ করছে।

এই অবস্থায় গবেষকেরা সতর্ক করেছেন, সাধারণ কেনাকাটার ক্ষেত্রে এআইয়ের এসব ভুলত্রুটি বড় সমস্যা মনে না হলেও, জটিল ক্ষেত্রগুলোয় এর প্রভাব ভয়াবহ হতে পারে।

গবেষণা নিবন্ধের প্রধান রচয়িতা আবির আলেসা লাইভ সায়েন্সকে বলেন, ‘স্বাস্থ্যসেবা সংক্রান্ত নথিপত্র বা শিক্ষাপ্রতিষ্ঠানে ভর্তির প্রোফাইল সারাংশ করার ক্ষেত্রে যদি এআই এভাবে তথ্যের মোড়ক বদলে দেয়, তবে তা কোনো ব্যক্তি বা বিষয় সম্পর্কে মানুষের পুরো ধারণা ভুল পথে পরিচালিত করতে পারে।’

গবেষক দলটি আশা করছে, এই গবেষণার মাধ্যমে এআইয়ের তৈরি করা তথ্যের বিকৃতি রোধ করা এবং সংবাদমাধ্যম, শিক্ষা ও সরকারি নীতিনির্ধারণী ক্ষেত্রে এর নেতিবাচক প্রভাব কমানো সম্ভব হবে।

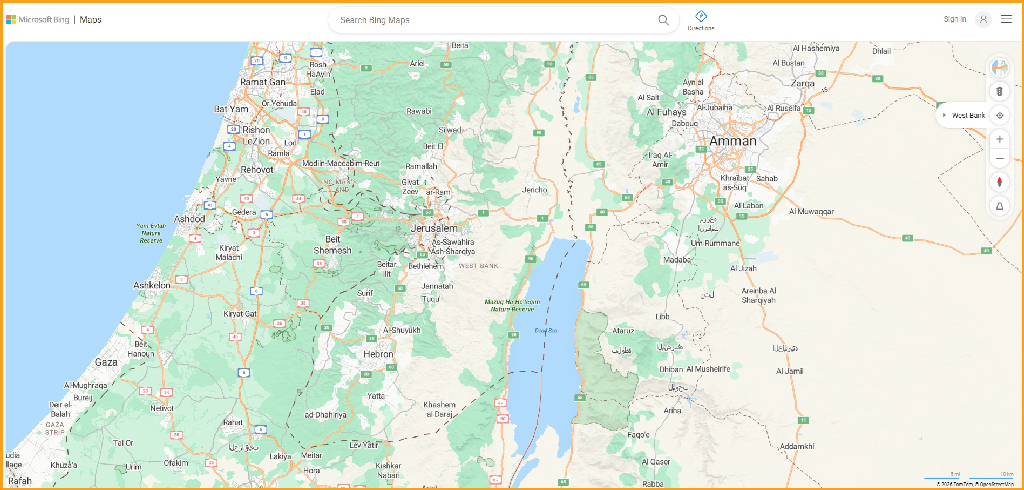

অধিকৃত পশ্চিম তীরের মানচিত্র থেকে ইসরায়েলি নাম মুছে ফেলেছে প্রযুক্তি জায়ান্ট মাইক্রোসফট। একই সঙ্গে ডিজিটাল মানচিত্রে ফিলিস্তিনি ভৌগোলিক নামগুলো অন্তর্ভুক্ত করেছে প্রতিষ্ঠানটি। আন্তর্জাতিক আইনের সঙ্গে সংগতি রেখে এ সিদ্ধান্ত নেওয়া হয়েছে বলে জানিয়েছে প্রযুক্তি প্রতিষ্ঠানটি।

১৬ ঘণ্টা আগে

স্মার্টফোন প্রেমীদের জন্য দুই দিনের ব্যাটারি ব্যাকআপ এখন আর স্বপ্ন নয়। ওয়ানপ্লাস, অনার এবং শাওমির মতো প্রতিষ্ঠানগুলো এখন ব্যাটারি প্রযুক্তির এমন এক স্তরে পৌঁছেছে যেখানে ৮ হাজার থেকে ১০ হাজার মিলিঅ্যাম্পিয়ার (mAh) ব্যাটারি খুবই সাধারণ বিষয় হয়ে দাঁড়িয়েছে।

২ দিন আগে

ব্রাজিলিয়ান ফুটবল তারকা রাফিনহাকে গ্লোবাল ব্র্যান্ড অ্যাম্বাসেডর হিসেবে ঘোষণা করেছে স্মার্টফোন ব্র্যান্ড রিয়েলমি। আসন্ন ফিফা বিশ্বকাপ ঘিরে বিশ্বজুড়ে যখন ফুটবল উন্মাদনা বাড়ছে, ঠিক সেই সময় এই ঘোষণা দিলো ব্র্যান্ডটি।

২ দিন আগে

প্রায় ৪৫৪ কোটি বছরের পুরোনো এই পৃথিবীর বুকে আজ থেকে অন্তত ৭০ লাখ বছর আগে কিছুটা মানুষের মতো একধরনের প্রাণীর অস্তিত্ব ছিল বলে ধারণা করা হয়। আর অনেকটাই মানুষের মতো প্রাণীদের পদচারণের চিহ্ন খুঁজতে গিয়ে গবেষকেরা জানিয়েছেন, ‘হোমো’ গণের উদ্ভব ঘটেছিল ৩০ লাখ বছর আগে। এরপর ৮ থেকে ১০টি প্রজাতির মানুষ এই

২ দিন আগে